產品同質化嚴重?市場競爭激烈?農資新“藍海”竟然是技術咨詢

在當今農資市場中,產品同質化已成為許多企業面臨的共同挑戰。化肥、農藥、種子等傳統農資產品在功能、包裝和營銷方式上日趨相似,導致價格戰頻發,利潤空間不斷壓縮。加之市場競爭激烈,農資經銷商和制造商往往陷入被動局面。正是在這種看似紅海的背景下,一個新的“藍海”正在悄然崛起——農資技術咨詢。

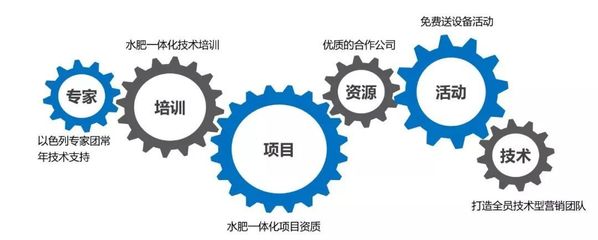

農資技術咨詢并非簡單的產品銷售,而是以專業知識為核心,為農戶提供作物種植、病蟲害防治、施肥方案、土壤改良等全方位技術服務。這種模式的優勢在于,它不僅解決了農戶在實際生產中遇到的技術難題,還幫助農資企業從單純的產品供應商轉型為綜合解決方案提供者。通過技術咨詢,企業可以建立更強的用戶粘性,提升品牌價值,并實現差異化競爭。

例如,一些領先的農資公司已經開始整合農業專家資源,推出線上咨詢平臺或田間指導服務,幫助農戶優化種植結構,提高作物產量和品質。這種服務不僅增強了客戶忠誠度,還為企業帶來了可持續的收入來源。隨著智慧農業和數字化技術的普及,農資技術咨詢的市場潛力將進一步釋放,成為農資行業轉型升級的關鍵驅動力。

面對產品同質化和市場競爭的雙重壓力,農資企業應積極擁抱技術咨詢這一“藍海”機遇,通過創新服務模式,實現從“賣產品”到“賣服務”的戰略轉型,從而在激烈的市場環境中脫穎而出。

如若轉載,請注明出處:http://m.boyou88.cn/product/1.html

更新時間:2026-05-20 05:08:51